Professional Documents

Culture Documents

Regresion Lineal Multiple 3

Uploaded by

May RezaCopyright

Available Formats

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

Available Formats

Regresion Lineal Multiple 3

Uploaded by

May RezaCopyright:

Available Formats

Regresión lineal múltiple

J. M. Rojo Abuín

Instituto de Economía y Geografía

Madrid, II-2007

José Manuel Rojo 1

Índice

I. INTRODUCCIÓN .................................................................................................. 2

II. EL MODELO DE REGRESIÓN LINEAL MÚLTIPLE........................................ 5

III. HIPÓTESIS............................................................................................................. 6

IV. ESTIMACIÓN DE LOS PARÁMETROS POR MÍNIMOS CUADRADOS........ 7

V. VARIANZA RESIDUAL ..................................................................................... 11

VI. CONTRASTE DE REGRESIÓN ......................................................................... 13

VII. COEFICIENTE DE DETERMINACIÓN R2 ....................................................... 16

VIII. DIAGNOSIS Y VALIDACIÓN DE UN MODELO DE REGRESIÓN LINEAL

MÚLTIPLE ........................................................................................................... 17

VIII.1. Multicolinealidad .................................................................................................. 17

VIII.2. Análisis de residuos .............................................................................................. 18

VIII.3. Valores de influencia (leverage) ........................................................................... 20

VIII.4. Contrastando las hipótesis básicas ........................................................................ 21

VIII.5. Homocedasticidad ................................................................................................. 22

VIII.6. Errores que deben de evitarse ............................................................................... 23

IX. SELECCIÓN DE LAS VARIABLES REGRESORAS ....................................... 24

X. EJEMPLO 1 .......................................................................................................... 25

José Manuel Rojo 1

I. Introducción

En el capitulo anterior se ha estudiado el modelo de regresión lineal simple,

donde se analizaba la influencia de una variable explicativa X en los valores que toma

otra variable denominada dependiente (Y).

En la regresión lineal múltiple vamos a utilizar más de una variable explicativa;

esto nos va a ofrecer la ventaja de utilizar más información en la construcción del

modelo y, consecuentemente, realizar estimaciones más precisas.

Al tener más de una variable explicativa (no se debe de emplear el término

independiente) surgirán algunas diferencias con el modelo de regresión lineal simple.

Una cuestión de gran interés será responder a la siguiente pregunta: de un vasto

conjunto de variables explicativas: x1, x2, …, xk, cuáles son las que más influyen en

la variable dependiente Y.

En definitiva, y al igual que en regresión lineal simple, vamos a considerar que

los valores de la variable dependiente Y han sido generados por una combinación lineal

de los valores de una o más variables explicativas y un término aleatorio:

y = b0 + b1 ⋅ x1 + b2 ⋅ x2 + ... + bk ⋅ xk + u

Los coeficientes son elegidos de forma que la suma de cuadrados entre los

valores observados y los pronosticados sea mínima, es decir, que se va a minimizar la

varianza residual.

Esta ecuación recibe el nombre de hiperplano, pues cuando tenemos dos

variables explicativas, en vez de recta de regresión tenemos un plano:

José Manuel Rojo 2

A

Linear Regression

e + 1,41 * a_espald

A

A

A A A

A

A

A

A A A

A A

A

A

A

AA

A A

A

A

A

A

Con tres variables explicativas tendríamos un espacio de tres dimensiones, y así

sucesivamente.

Vamos a ir introduciendo los elementos de este análisis a través de un

sencillo ejemplo.

Consideramos una muestra de personas como la que sigue a continuación:

Registr

sexo estatura l_roxto pie l_brazo a_espald d_cráneo peso

o

X1 X6 X2 X3 X4 X5 Y

1 mujer 158 39 36 68 43 55 43

2 mujer 152 38 34 66 40 55 45

3 mujer 168 43 39 72.5 41 54.5 48

4 mujer 159 40 36 68.5 42 57 49

5 mujer 158 41 36 68.5 44 57 50

6 mujer 164 40 36 71 44.5 54 51

7 mujer 156 41 36 67 36 56 52

8 mujer 167 44 37 73 41.5 58 52

En base a estos datos, vamos a construir un modelo para predecir el peso de una

persona (Y). Esto equivale a estudiar la relación existente entre este conjunto de

variables x1 ,..., x5 y la variable peso (Y).

José Manuel Rojo 3

En primer lugar tenemos que la variable dependiente es el peso; y las variables

que vamos a utilizar para predecir el peso reciben el nombre de variables independientes

o explicativas.

En la práctica deberemos de elegir cuidadosamente qué variables vamos a

considerar como explicativas. Algunos criterios que deben de cumplir serán los

siguientes:

Tener sentido numérico.

No deberá de haber variables repetidas o redundantes

Las variables introducidas en el modelo deberán de tener una cierta

justificación teórica.

La relación entre variables explicativas en el modelo y casos debe de ser

como mínimo de 1 a 10.

La relación de las variables explicativas con la variable dependiente debe de

ser lineal, es decir, proporcional.

José Manuel Rojo 4

II. El Modelo de regresión lineal múltiple

El modelo de regresión lineal múltiple es idéntico al modelo de regresión lineal

simple, con la única diferencia de que aparecen más variables explicativas:

Modelo de regresión simple:

y = b0 + b1 ⋅ x + u

Modelo de regresión múltiple:

y = b0 + b1 ⋅ x1 + b2 ⋅ x2 + b3 ⋅ x3 + ... + bk ⋅ xk + u

Siguiendo con nuestro ejemplo, si consideramos el peso como variable

dependiente y como posibles variables explicativas:

estatura

pie

l_brazo

a_espald

d_craneo

El modelo que deseamos construir es:

peso = b0 + b1 ⋅ estatura + b2 ⋅ pie + b3 ⋅ l _ brazo + b4 ⋅ a _ espald + b5 ⋅ d _ craneo

Al igual que en regresión lineal simple, los coeficientes b van a indicar el

incremento en el peso por el incremento unitario de la correspondiente variable

explicativa. Por lo tanto, estos coeficientes van a tener las correspondientes unidades de

medida.

José Manuel Rojo 5

III. Hipótesis

Para realizar un análisis de regresión lineal múltiple se hacen las siguientes

consideraciones sobre los datos:

a) Linealidad: los valores de la variable dependiente están generados por el

siguiente modelo lineal:

Y = X * B +U

b) Homocedasticidad: todas las perturbaciones tienen las misma varianza:

V (ui ) = σ 2

c) Independencia: las perturbaciones aleatorias son independientes entre sí:

E (ui ⋅ u j ) = 0, ∀i ≠ j

d) Normalidad: la distribución de la perturbación aleatoria tiene distribución

normal:

U ≈ N (0, σ 2 )

e) Las variables explicativas Xk se obtienen sin errores de medida.

Si admitimos que los datos presentan estas hipótesis entonces el teorema de

Gauss-Markov establece que el método de estimación de mínimos cuadrados va a

producir estimadores óptimos, en el sentido que los parámetros estimados van a estar

centrados y van a ser de mínima varianza.

José Manuel Rojo 6

IV. Estimación de los parámetros por mínimos cuadrados

Vamos a calcular un hiperplano de regresión de forma que se minimice la

varianza residual:

Min∑ ( y j − yˆ j ) 2

Donde:

yˆ j = b0 + b1 * x1,1 + b2 * x2, j + ...bk * xk , j

Utilizando notación matricial:

⎡ u1 ⎤ ⎡ y1 − yˆ1 ⎤

⎢u ⎥ ⎢ y − y ⎥

⎢ 2 ⎥ ⎢ 2 ˆ2 ⎥

u = ⎢ . ⎥ = ⎢ . ⎥ = y − yˆ

⎢ ⎥ ⎢ ⎥

⎢.⎥ ⎢ . ⎥

⎢⎣un ⎥⎦ ⎢⎣ yn − yˆ n ⎥⎦

José Manuel Rojo 7

Y teniendo en cuenta la definición de ŷ :

⎡ u1 ⎤ ⎡ y1 − b0 − b1 * x1,1 − b2 * x2,1 − b3 * x3,1 − ... − bk * xk ,1 ⎤

⎢u ⎥ ⎢ y − b − b * x − b * x − b * x − ... − b * x ⎥

⎢ 2 ⎥ ⎢ 2 0 1 1, 2 2 2, 2 3 3, 2 k k ,2 ⎥

u=⎢ . ⎥=⎢ . ⎥ = y − yˆ

⎢ ⎥ ⎢ ⎥

⎢.⎥ ⎢ . ⎥

⎢⎣u n ⎥⎦ ⎢⎣ yn − b0 − b1 * x1,n − b2 * x2,n − b3 * x3,n − ... − bk * xk ,n ⎥⎦

Por lo tanto:

⎡ y1 ⎤ ⎡1 x1,1 . . xk ,1 ⎤ ⎡b0 ⎤

⎢ y ⎥ ⎢1 x . . xk , 2 ⎥⎥ ⎢ b1 ⎥

⎢ 2⎥ ⎢ 1, 2 ⎢ ⎥

u = ⎢ ⎥−⎢ . ⎥ * ⎢ . ⎥ = y − X *b

⎢ ⎥ ⎢ ⎥ ⎢ ⎥

⎢ ⎥ ⎢ . ⎥ ⎢.⎥

⎢⎣ yn ⎥⎦ ⎢⎣1 x1,n xk ,n ⎥⎦ ⎢⎣bk ⎥⎦

Por lo tanto la varianza residual se puede expresar de la siguiente forma:

n * σ 2 = u′ * u = ( y − X * b)′ * ( y − X * b)

Es decir:

Φ(b) = ∑ ( y j − yˆ j ) 2 = u′ * u

Por tanto, la varianza residual es una función del vector de parámetros b y la

condición para que tenga un mínimo será:

∂φ (b)

=0

∂b

José Manuel Rojo 8

Antes de derivar vamos a simplificar la expresión de la varianza residual:

n * σ 2 = u ′ * u = ( y − x * b )′ * ( y − x * b ) = y ′ * y − y ′ * x * b − b ′ * x ′ * y + b ′ * x ′ * x * b

Por lo tanto:

Φ (b) = ∑ ( y j − yˆ j ) 2 = u ′ * u = y′ * y − y ′ * x * b − b′ * x′ * y + b′ * x′ * x * b

∂ φ (b ) ∂ ( y − X * b ) ′ * ( y − X * b )

= = −2 * X ′ * Y + 2 * X ′ * X * B

∂b ∂b

Igualando a cero y despejando:

X ′ *Y = X ′ * X * B

y si X ′ * X es matriz no singular y por lo tanto tiene inversa, tenemos:

X ′ *Y = X ′ * X * B

Multiplicando por ( X ′ * X ) −1

( X ′ * X ) −1 X ′ * Y = ( X ′ * X ) − 1 X ′ * X * B

( X ′ * X ) −1 X ′ * Y = I * B

B = ( X ′ * X ) −1 * X ′ * Y

Ésta es la expresión del estimador de parámetros B .

José Manuel Rojo 9

Además

X ′ *Y = X ′ * X * B

X ′ *Y − X ′ * X * B = 0

X ′ * (Y − X * B ) = 0

X ′ *U = 0

Es decir, los residuos obtenidos del modelo estimado por mínimos cuadrados no

van a estar correlacionados con las variables explicativas.

Nota

Es importante observar que si las variables explicativas X están muy

correlacionadas entre si, la matriz ( X ′ * X ) va a tener el determinante con valor cero o

muy cercano a cero.

Si hay al menos una variable que puede ser expresada como combinación lineal

del resto (ingresos mensuales, ingresos anuales) el determinante de esta matriz es cero y

dicha matriz será singular y por lo tanto no tendrá inversa.

Si no hay variables que sean combinación lineal de las demás, pero están

fuertemente correlacionadas, el determinante no será cero pero tendrá un valor muy

próximo a cero; este caso va a producir una inestabilidad en la solución del estimador,

en general, se va a producir un aumento en su varianza.

En estos casos se impone la utilización de un método de selección de variables

explicativas.

A los problemas provocados por la fuerte correlación entre las variables

explicativas se les llama multicolinealidad.

José Manuel Rojo 10

V. Varianza residual

Al igual que en el caso de regresión lineal simple, vamos a descomponer la

variabilidad de la variable dependiente Y en dos componentes o fuentes de variabilidad:

una componente va a representar la variabilidad explicada por el modelo de regresión y

la otra componente va a representar la variabilidad no explicada por el modelo y, por

tanto, atribuida a factores aleatorios.

Consideramos la variabilidad de la variable dependiente como:

n *σ 2 = ∑ ( yi − Y ) 2

Es decir, la variabilidad de Y es la suma cuadrática de los valores que toma la

variable respecto a la media de la variable.

Sumando y restando el valor pronosticado por el modelo de regresión obtenemos

la siguiente expresión:

∑ ( y − y ) = ∑ ( y) − y ) + ∑ ( y − y) )

i

2

i

2

i i

2

Es decir, que la suma de cuadrados de la variable Y respecto a su media se puede

descomponer en términos de la varianza residual. De esta expresión se deduce que “la

distancia de Y a su media se descompone como la distancia de Y a su estimación más la

distancia de su estimación a la media”.

Teniendo en cuenta que el último término representa la varianza no explicada,

tenemos:

VT = VE + VNE

José Manuel Rojo 11

Gráficamente es fácil ver la relación:

Dividiendo la variabilidad total entre sus grados de libertad obtenemos la

varianza de la variable dependiente Y :

VT

SY2 =

n −1

Dividiendo la variabilidad no explicada entre sus grados de libertad obtenemos

la varianza residual de la variable dependiente Y :

VNE

S R2 =

n − (k + 1)

Tabla resumen

Suma de cuadrados Grados de libertad

∑ ( y − y)

VT

VT

2

n-1 SY2 =

n −1

VE ∑ ( yˆ − y )

2

k-1

)

∑ ( y − y)

VNE

VNE

2

n-k-1 S R2 =

n − k −1

José Manuel Rojo 12

VI. Contraste de regresión

Como estamos sacando conclusiones de una muestra de un conjunto mucho más

amplio de datos, a veces este conjunto será infinito, es obvio que distintas muestras van

a dar distintos valores de los parámetros.

Un caso de especial interés es asignar una medida de probabilidad a la siguiente

afirmación o hipótesis:

H 0 ≡ b1 = b2 = ... = bk = 0

La afirmación contraria sería:

H 1 ≡ ∃b j ≠ 0

Nota

La hipótesis nula es que todos los coeficientes menos b0 son nulos y la hipótesis

alternativa o complementaria es que existe al menos uno que es distinto de 0, puede

haber varios que sean nulos, pero al menos existe uno distinto de cero.

Se denomina contraste de regresión al estudio de la posibilidad de que el modelo

de regresión sea nulo, es decir, los valores de las variables explicativas X no van a

influir en la variable Peso.

José Manuel Rojo 13

Construcción del contraste

Si los residuos siguen una distribución normal y b1 = b2 = ... = bk = 0 , tenemos

que:

VT

≈ χ n2−1

σ 2

VE

≈ χ12

σ2

VNE

≈ χ n2− ( k +1)

σ 2

Por tanto:

VE

1 VE

= ≈ F1, n − ( k +1)

VNE S R2

n − (k + 1)

Es decir, el cociente entre la varianza explicada y la varianza no explicada será

aproximadamente 1. Además, al seguir una distribución F, podemos asignar una

medida de probabilidad (p-value) a la hipótesis de que la varianza explicada es igual a la

varianza no explicada.

En caso contrario la varianza no explicada será muy inferior a la varianza

explicada y, por lo tanto, este cociente tendrá un valor muy superior a 1.

Nota

En general si el p-value es menor de 0.05 se acepta que el modelo de regresión

es significativo; en caso contrario no podemos hablar de regresión, pues el modelo sería

nulo.

José Manuel Rojo 14

Si aceptamos que el modelo de regresión es significativo, es habitual mostrar el

p-value; por ejemplo:

Encontramos que este modelo de regresión es estadísticamente significativo con un

p-value de 0.0003

José Manuel Rojo 15

VII. Coeficiente de determinación R2

Vamos a construir un coeficiente (estadístico) que mida la bondad del ajuste del

modelo. Si bien la varianza residual ( S R2 ) nos indica cómo están de cerca las

estimaciones respecto de los puntos, esta varianza está influida por la varianza de la

variable dependiente, la cual, a su vez, está influida por su unidad de medida. Por lo

tanto, una medida adecuada es la proporción de la varianza explicada (VE) entre la

varianza total (VT); de este modo, definimos el coeficiente de determinación R 2 :

VE VT − VNE VNE

R2 = = = 1−

VT VT VT

Por ser cociente de sumas de cuadrados, este coeficiente será siempre positivo.

Si todos los puntos están sobre la recta de regresión, la varianza no explicada

será 0, y por lo tanto:

VE 0

R2 = = 1− =1

VT VT

Este coeficiente es muy importante pues determina qué porcentaje (en tantos por

uno) de la varianza de la variable dependiente es explicado por el modelo de regresión.

En general, se pueden clasificar los valores de R 2 de la siguiente manera:

Menor de 0.3 0.3 a 0.4 0.4 a 0.5 0.5 a 0.85 Mayor de 0.85

Muy malo Malo Regular Bueno Sospechoso

Además, a diferencia de la varianza residual, este coeficiente es adimensional;

esto quiere decir que no está afectado por transformaciones lineales de las variables; por

ello, si cambiamos las unidades de medida, el coeficiente de determinación permanecerá

invariante.

José Manuel Rojo 16

VIII. Diagnosis y validación de un modelo de regresión lineal múltiple

VIII.1. Multicolinealidad

Si las variables explicativas se pueden expresar como una combinación lineal:

α1 x1 + α 2 x2 + ... + α k xk + α 0 = 0

Se dice que tenemos un problema de multicolinealidad.

En general, este problema va a afectar incrementando la varianza de los

estimadores.

Este problema se detecta fácilmente:

• Solicitando el determinante de la matriz de varianzas-covarianzas, que estará

cercano a cero.

• Calculando el cociente entre el primer y último autovalor de la matriz de

varianzas-covarianzas que será mayor de 50.

• Calculando para cada variable el coeficiente de determinación ( R 2 ) de dicha

variable con el resto.

La solución es eliminar del modelo aquellas variables explicativas que dependen

unas de otras. En general, los métodos de selección de variables solucionan

automáticamente este problema.

ANOVAb

Sum of

Model Squares df Mean Square F Sig.

1 Regression 3485,401 6 580,900 14,986 ,000a

Residual 775,265 20 38,763

Total 4260,667 26

a. Predictors: (Constant), l_roxto Longitud de rodilla a tobillo, d_cráneo, a_espald, l_

brazo, pie, estatura

b. Dependent Variable: peso

José Manuel Rojo 17

Coefficientsa

Unstandardized Standardized

Coefficients Coefficients Collinearity Statistics

Model B Std. Error Beta t Sig. Tolerance VIF

1 (Constant) -133,261 43,985 -3,030 ,007

estatura -,354 ,445 -,283 -,796 ,435 ,072 13,882

pie 2,187 1,248 ,489 1,752 ,095 ,117 8,574

l_brazo ,821 ,621 ,317 1,323 ,201 ,159 6,307

a_espald 1,067 ,660 ,335 1,616 ,122 ,212 4,724

d_cráneo 1,093 ,922 ,157 1,186 ,250 ,517 1,933

l_roxto Longitud

-,003 ,841 -,001 -,004 ,997 ,212 4,724

de rodilla a tobillo

a. Dependent Variable: peso

En esta tabla se muestra el valor de los estimadores del hiperplano de regresión.

La columna denominada tolerancia es:

1 − R2

Donde la variable correspondiente entra como variable dependiente y el resto de

las variables explicativas actúan como regresoras.

A la vista de estos resultados, la variable estatura esta provocando problemas de

multicolinealidad.

Es interesante observar que si bien el contraste de regresión es significativo,

ninguna de las variables explicativas lo es.

VIII.2. Análisis de residuos

Definimos como residuo del i-esimo caso a:

ui = yi − yˆi

Los residuos son variables aleatorias que siguen (¿?) una distribución normal.

Los residuos tienen unidades de medida y, por tanto no se puede determinar si es grande

o pequeño a simple vista.

José Manuel Rojo 18

Para solventar este problema se define el residuo estandarizado como:

ui 1

Zui = *

SˆR 1 − hii

Se considera que un residuo tiene un valor alto, y por lo tanto puede influir

negativamente en el análisis, si su residuo estandarizado es mayor de 3 en valor

absoluto.

⎣Zui ⎦ ≥ 3

Para evitar la dependencia entre numerador y denominador de la expresión

anterior, también se utilizan los residuos estudentizados.

ui 1

SZui = *

ˆ

S (i ) R 1 − hii

Donde Sˆ (i ) R es la varianza residual calculada sin considerar el i-esimo caso.

El análisis descriptivo y el histograma de los residuos nos indicarán si existen

casos que no se adapten bien al modelo lineal.

Residuals Statisticsa

Minimum Maximum Mean Std. Deviation N

Predicted Value 23,9527 138,1509 71,2963 25,44848 27

Residual -31,69022 117,84905 ,00000 29,60339 27

Std. Predicted Value -1,860 2,627 ,000 1,000 27

Std. Residual -,939 3,492 ,000 ,877 27

a. Dependent Variable: peso

José Manuel Rojo 19

Podemos observar que hay un caso que tiene un residuo anormal, pues su valor

tipificado es 3.49.

VIII.3. Valores de influencia (leverage)

Se considera que una observación es influyente a priori si su inclusión en el

análisis modifica sustancialmente el sentido del mismo.

Una observación puede ser influyente si es un outlayer respecto a alguna de las

variables explicativas:

José Manuel Rojo 20

Para detectar estos problemas se utiliza la medida de Leverage:

1 ( x − x )2

l (i ) = (1 + i 2 )

n sx

Este estadístico mide la distancia de un punto a la media de la distribución.

Valores cercanos a 2/n indican casos que pueden influir negativamente en la

estimación del modelo introduciendo un fuerte sesgo en el valor de los estimadores.

VIII.4. Contrastando las hipótesis básicas

Normalidad de los residuos.

Para verificar esta hipótesis se suele utilizar el histograma de los residuos y en

caso necesario el test de Kolgomorov Smirnov.

One-Sample Kolmogorov-Smirnov Test

ZRE_1

Standardized

Residual

N 27

Normal Parameters a,b Mean ,0000000

Std. Deviation ,87705802

Most Extreme Absolute ,117

Differences Positive ,117

Negative -,105

Kolmogorov-Smirnov Z ,609

Asymp. Sig. (2-tailed) ,852

a. Test distribution is Normal.

b. Calculated from data.

En este caso no se detecta falta de normalidad, el pvalue del test KS es de 0.852,

por lo tanto se concluye que:

No se encuentran diferencias estadísticamente significativas para rechazar la hipótesis

de normalidad.

José Manuel Rojo 21

VIII.5. Homocedasticidad

La hipótesis de homocedasticidad establece que la variabilidad de los residuos es

independiente de las variables explicativas.

En general, la variabilidad de los residuos estará en función de las variables

explicativas, pero como las variables explicativas están fuertemente correlacionadas con

la variable dependiente, bastara con examinar el gráfico de valores pronosticados versus

residuos al cuadrado.

Este es un claro ejemplo de falta de homocedasticidad.

Existe una familia de transformaciones denominada Box-CCOS que se realizan

sobre la variable dependiente encaminadas a conseguir homocedasticidad. La

transformación más habitual para conseguir homocedasticidad es:

Y ′ = log(Y )

En cualquier caso, es conveniente examinar detenidamente las implicaciones de

realizar este tipo de transformaciones, pues en muchas ocasiones es peor el remedio que

la enfermedad, ya que la variable dependiente puede llegar a perder el sentido.

José Manuel Rojo 22

VIII.6. Errores que deben de evitarse

Errores que son fáciles pasar por alto al realizar un modelo de regresión lineal

múltiple son los siguientes:

• No controlar el factor tamaño.

• Si hay un factor de ponderación, no tenerlo en cuenta.

• Al calcular los grados de libertad en los contrastes de hipótesis.

• No incluir una variable relevante en el modelo.

• Incluir una variable irrelevante.

• Especificar una relación lineal que no lo es.

José Manuel Rojo 23

IX. Selección de las variables regresoras

Los procedimientos para seleccionar las variables regresoras son los siguientes:

• Eliminación progresiva.

• Introducción progresiva.

• Regresión paso a paso (Stepwise Regression).

Este último método es una combinación de los procedimientos anteriores. Parte

del modelo sin ninguna variable regresora y en cada etapa se introduce la más

significativa, pero en cada etapa examina si todas las variables introducidas en el

modelo deben de permanecer. Termina el algoritmo cuando ninguna variable entra o

sale del modelo.

José Manuel Rojo 24

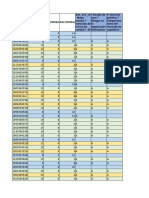

X. Ejemplo 1

Statistics

l_roxto

Longitud

de rodilla

estatura peso pie l_brazo a_espald d_cráneo a tobillo

N Valid 27 27 27 27 27 27 27

Missing 0 0 0 0 0 0 0

Mean 168,7963 63,8889 38,9815 73,4815 45,8519 57,2407 43,0926

Median 168,0000 65,0000 39,0000 73,0000 46,0000 57,0000 43,0000

Std. Deviation 10,22089 12,80124 2,86384 4,93707 4,02113 1,84167 3,15630

Skewness ,173 ,187 ,303 ,427 -,249 ,178 ,632

Std. Error of Skewness ,448 ,448 ,448 ,448 ,448 ,448 ,448

Kurtosis -1,016 -,658 -,855 -,605 ,075 -,740 1,044

Std. Error of Kurtosis ,872 ,872 ,872 ,872 ,872 ,872 ,872

Minimum 152,00 43,00 34,00 66,00 36,00 54,00 38,00

Maximum 189,00 91,00 45,00 83,00 53,00 61,00 52,00

José Manuel Rojo 25

Model Summaryb

Adjusted Std. Error of Durbin-

Model R R Square R Square the Estimate Watson

1 ,904a ,818 ,763 6,22602 2,274

a. Predictors: (Constant), l_roxto Longitud de rodilla a tobillo, d_cráneo, a_

espald, l_brazo, pie, estatura

b. Dependent Variable: peso

ANOVAb

Sum of

Model Squares df Mean Square F Sig.

1 Regression 3485,401 6 580,900 14,986 ,000a

Residual 775,265 20 38,763

Total 4260,667 26

a. Predictors: (Constant), l_roxto Longitud de rodilla a tobillo, d_cráneo, a_espald, l_

brazo, pie, estatura

b. Dependent Variable: peso

José Manuel Rojo 26

Coefficientsa

Unstandardized Standardized

Coefficients Coefficients Collinearity Statistics

Model B Std. Error Beta t Sig. Tolerance VIF

1 (Constant) -133,261 43,985 -3,030 ,007

estatura -,354 ,445 -,283 -,796 ,435 ,072 13,882

pie 2,187 1,248 ,489 1,752 ,095 ,117 8,574

l_brazo ,821 ,621 ,317 1,323 ,201 ,159 6,307

a_espald 1,067 ,660 ,335 1,616 ,122 ,212 4,724

d_cráneo 1,093 ,922 ,157 1,186 ,250 ,517 1,933

l_roxto Longitud

-,003 ,841 -,001 -,004 ,997 ,212 4,724

de rodilla a tobillo

a. Dependent Variable: peso

Residuals Statisticsa

Minimum Maximum Mean Std. Deviation N

Predicted Value 44,1230 88,5975 63,8889 11,57816 27

Residual -8,21203 11,34415 ,00000 5,46058 27

Std. Predicted Value -1,707 2,134 ,000 1,000 27

Std. Residual -1,319 1,822 ,000 ,877 27

a. Dependent Variable: peso

José Manuel Rojo 27

El mismo análisis pero utilizando un algoritmo de selección de variables.

Model Summaryc

Adjusted Std. Error of Durbin-

Model R R Square R Square the Estimate Watson

1 ,850a ,722 ,711 6,88269

2 ,891b ,794 ,777 6,05049 2,120

a. Predictors: (Constant), pie

b. Predictors: (Constant), pie, a_espald

c. Dependent Variable: peso

ANOVAc

Sum of

Model Squares df Mean Square F Sig.

1 Regression 3076,382 1 3076,382 64,942 ,000a

Residual 1184,285 25 47,371

Total 4260,667 26

2 Regression 3382,065 2 1691,032 46,192 ,000b

Residual 878,602 24 36,608

Total 4260,667 26

a. Predictors: (Constant), pie

b. Predictors: (Constant), pie, a_espald

c. Dependent Variable: peso

Coefficientsa

Unstandardized Standardized

Coefficients Coefficients Collinearity Statistics

Model B Std. Error Beta t Sig. Tolerance VIF

1 (Constant) -84,173 18,421 -4,569 ,000

pie 3,798 ,471 ,850 8,059 ,000 1,000 1,000

2 (Constant) -87,250 16,228 -5,376 ,000

pie 2,213 ,687 ,495 3,219 ,004 ,363 2,753

a_espald 1,415 ,490 ,444 2,890 ,008 ,363 2,753

a. Dependent Variable: peso

José Manuel Rojo 28

Collinearity Diagnosticsa

Condition Variance Proportions

Model Dimension Eigenvalue Index (Constant) pie a_espald

1 1 1,997 Residuals Statisticsa ,00

1,000 ,00

2 ,003

Minimum 27,778

Maximum Mean1,00 Std. Deviation

1,00 N

2 Predicted

1 Value 2,995

43,3520 1,000

87,3214 63,8889 ,00 ,00

11,40524 ,0027

2

Residual ,004

-10,25595 27,747

12,53056 ,00000,83 ,02

5,81312 ,2227

3

Std. Predicted Value ,001

-1,801 50,270

2,055 ,17

,000 ,98

1,000 ,7827

Std. Residual Variable: peso

a. Dependent -1,695 2,071 ,000 ,961 27

a. Dependent Variable: peso

José Manuel Rojo 29

Histogram

Dependent Variable: peso

6

Frequency

Mean = 1,99E-15

Std. Dev. = 0,961

0

José Manuel Rojo 30

José Manuel Rojo 31

You might also like

- Accelerating global research insightsDocument33 pagesAccelerating global research insightscamila arangoNo ratings yet

- CRIMINOLOGIA1Document7 pagesCRIMINOLOGIA1Daniel CastellanoNo ratings yet

- Fases proyecto sistemas informaciónDocument12 pagesFases proyecto sistemas informaciónCamilo enciso coNo ratings yet

- Planillas de Limpiezas y DesinfeccionDocument10 pagesPlanillas de Limpiezas y DesinfeccionEduard Piracoca LinaresNo ratings yet

- Calificacionesn26nn18n08n22 236300119049927Document10 pagesCalificacionesn26nn18n08n22 236300119049927Camilo enciso coNo ratings yet

- Calificaciones 2282340 FASE PLANEACION APRENDICES 03-03-2022Document64 pagesCalificaciones 2282340 FASE PLANEACION APRENDICES 03-03-2022Martin Hemirson Perez SanchezNo ratings yet

- Matrices en GeoGebraDocument1 pageMatrices en GeoGebraClau Granados MoraNo ratings yet

- RegNotas 03237330 20 B02023 B2 33982Document6 pagesRegNotas 03237330 20 B02023 B2 33982carlos huariNo ratings yet

- Ají de GallinaDocument1 pageAjí de GallinaFavio Gael GutiérrezNo ratings yet

- RegNotas 05643440 20 B02022 B2 18777Document6 pagesRegNotas 05643440 20 B02022 B2 18777Gilder Apaestegui CubasNo ratings yet

- RegNotas 04937340 20 B02023 B2 65439Document6 pagesRegNotas 04937340 20 B02023 B2 65439carlos huariNo ratings yet

- RegNotas 06652730 20 F02023 B4 29241Document6 pagesRegNotas 06652730 20 F02023 B4 29241florenciodionicioponceNo ratings yet

- 012 Comprension LectoraDocument66 pages012 Comprension LectoraMRosa FdloNo ratings yet

- Universidad de Los Llanos Escuela de Medicina Veterinaria Y Zootecnia Laboratorio Bioquimíca MetabólicaDocument3 pagesUniversidad de Los Llanos Escuela de Medicina Veterinaria Y Zootecnia Laboratorio Bioquimíca MetabólicaNICOLE KATHERINE GARNICA PRADANo ratings yet

- Conejo EstudiandoDocument2 pagesConejo EstudiandoTlacuache KunNo ratings yet

- F-03 - Cafeterias ExistentesDocument1 pageF-03 - Cafeterias ExistentesSeremim Ltda.No ratings yet

- Ultimo Plan de Mejoramiento NoviembreDocument12 pagesUltimo Plan de Mejoramiento NoviembreKaroll Samuel Caro MorenoNo ratings yet

- Química Orgánica Alcanos CicloalcanosDocument30 pagesQuímica Orgánica Alcanos CicloalcanosFernando Ramirez MarquezNo ratings yet

- Izs Izc IzfDocument140 pagesIzs Izc IzfStace MacgiverNo ratings yet

- RegNotas 06652730 20 F02023 B4 53096Document6 pagesRegNotas 06652730 20 F02023 B4 53096florenciodionicioponceNo ratings yet

- Evaluación Informática 4°Document1 pageEvaluación Informática 4°CLAUDIA CARONo ratings yet

- Mitocondrias FelicesDocument189 pagesMitocondrias FelicesViviana VillagranNo ratings yet

- Morbilidad y Mortalidad MaternaDocument9 pagesMorbilidad y Mortalidad MaternaNatalia SolanoNo ratings yet

- RegNotas 04937340 20 B02023 B2 80196Document6 pagesRegNotas 04937340 20 B02023 B2 80196carlos huariNo ratings yet

- Centrondencalificacionesnn2104746 255fcac781523d0Document58 pagesCentrondencalificacionesnn2104746 255fcac781523d0michell adriana jimenezNo ratings yet

- Gestión del conocimiento en equipos de trabajo colaborativoDocument58 pagesGestión del conocimiento en equipos de trabajo colaborativomichell adriana jimenezNo ratings yet

- I-Registro Auxiliar Primaria 2019Document32 pagesI-Registro Auxiliar Primaria 2019dianaNo ratings yet

- RegNotas 06652730 20 F02023 B4 55848Document6 pagesRegNotas 06652730 20 F02023 B4 55848florenciodionicioponceNo ratings yet

- Hoja de Respuestas 16PFDocument1 pageHoja de Respuestas 16PFfrancyNo ratings yet

- 1° Medio Matemáticas Texto Estudiante Pág 156 163Document8 pages1° Medio Matemáticas Texto Estudiante Pág 156 163Orietta Andrea Riveros GonzálezNo ratings yet

- Cuestionarios y foros de investigación de mercadosDocument6 pagesCuestionarios y foros de investigación de mercadosVanessa AristizábalNo ratings yet

- RegistroAuxiliar. Matemática-PRIAMRIADocument2 pagesRegistroAuxiliar. Matemática-PRIAMRIAHernan S. M.No ratings yet

- Cópia de Relatorio de Líquido PenetranteDocument24 pagesCópia de Relatorio de Líquido PenetranteMarcos AndréNo ratings yet

- RegNotas 10951320 20 F02023 B1 46147Document6 pagesRegNotas 10951320 20 F02023 B1 46147Alfredo SánchezNo ratings yet

- Metodo Intuitivo AutomatizacionDocument26 pagesMetodo Intuitivo AutomatizacionJESSEN MORENONo ratings yet

- RegNotas 06652730 20 F02023 B4 60263Document6 pagesRegNotas 06652730 20 F02023 B4 60263florenciodionicioponceNo ratings yet

- Frecuencias y GraficasDocument42 pagesFrecuencias y GraficasClaudia CuetoNo ratings yet

- RegNotas 06652730 20 F02023 B4 12189Document6 pagesRegNotas 06652730 20 F02023 B4 12189florenciodionicioponceNo ratings yet

- Sesion 07 - Correlacion y RegresionDocument55 pagesSesion 07 - Correlacion y RegresionJorge Luis Gutierrez FiestasNo ratings yet

- RegNotas 09288200 20 B02023 T1 20382Document6 pagesRegNotas 09288200 20 B02023 T1 20382Eduardo Tapia CuelloNo ratings yet

- Mejoramiento Animal Chacon GomezDocument12 pagesMejoramiento Animal Chacon Gomezjhoan Ramiro Chacon GomezNo ratings yet

- Santo Grial Mexico 1 WWWWWWWWDocument72 pagesSanto Grial Mexico 1 WWWWWWWWByron Andres Castillo MendezNo ratings yet

- RegNotas 10951320 20 F02023 B1 51251Document7 pagesRegNotas 10951320 20 F02023 B1 51251Alfredo SánchezNo ratings yet

- AA1nAA2nFICHAn77 855fab6a891545aDocument6 pagesAA1nAA2nFICHAn77 855fab6a891545aJuan GuzmanNo ratings yet

- Plano Barrio CrespoDocument1 pagePlano Barrio CrespoCarmen GarcíaNo ratings yet

- Resultados de La Evaluación de Los AprendizajesDocument3 pagesResultados de La Evaluación de Los AprendizajesYanetNo ratings yet

- El Sistema Aduanero VenezolanoDocument3 pagesEl Sistema Aduanero VenezolanoJAENo ratings yet

- RegNotas 06652730 20 F02023 B4 36226Document6 pagesRegNotas 06652730 20 F02023 B4 36226florenciodionicioponceNo ratings yet

- Calificaciones 28-05-2021Document7 pagesCalificaciones 28-05-2021JUAN CAMILO CARDENAS URRIOLANo ratings yet

- Abex Catalogo 2014 - Digipubz FRENO O FRICIONES PDFDocument28 pagesAbex Catalogo 2014 - Digipubz FRENO O FRICIONES PDFDenis HernandezNo ratings yet

- Plano Detalle VentanasDocument1 pagePlano Detalle VentanasFredy OrtizNo ratings yet

- Registro Auxiliar de Arte y Personal SocialDocument43 pagesRegistro Auxiliar de Arte y Personal SocialFlor Jacqueline Mendoza OsorioNo ratings yet

- Ejerciios Taller Analisis de Sistemas de PotenciaDocument4 pagesEjerciios Taller Analisis de Sistemas de PotenciaYazmin Prada HernandezNo ratings yet

- Cuaderno Letrilandia 2Document73 pagesCuaderno Letrilandia 2Ángela0% (1)

- CUADERNO LETRILANDIA 2 Letras P L M SDocument73 pagesCUADERNO LETRILANDIA 2 Letras P L M SMari Trolli Jiji100% (1)

- Croquis de Parcelas de CocoDocument1 pageCroquis de Parcelas de CocoAndrés Espinosa MarroquínNo ratings yet

- RegNotas 17508760 20 F02023 B4 51065Document6 pagesRegNotas 17508760 20 F02023 B4 51065Doris DiazNo ratings yet

- Edo Del ArteDocument2 pagesEdo Del ArteMay RezaNo ratings yet

- SEMIOLOGÍADocument20 pagesSEMIOLOGÍAMay RezaNo ratings yet

- Lic Pedagogia InfantilDocument1 pageLic Pedagogia InfantilMay RezaNo ratings yet

- Diagramas de Flujo y ProcesosDocument17 pagesDiagramas de Flujo y ProcesosJuan Esteban Garcia100% (4)

- BM Con RXN Quimica 2010Document4 pagesBM Con RXN Quimica 2010May RezaNo ratings yet

- Cuestionario de EstadisticaDocument15 pagesCuestionario de EstadisticaRoberto Carlos Rivera RiosNo ratings yet

- Unidad 13 Distribuciones BidimensionalesDocument32 pagesUnidad 13 Distribuciones BidimensionalesSuNo ratings yet

- Repaso PC4Document20 pagesRepaso PC4NG05No ratings yet

- Examen Parcial de Metodologia de InvestigacionDocument7 pagesExamen Parcial de Metodologia de InvestigacionDaniel PfuñoNo ratings yet

- Estimación demanda regresiónDocument24 pagesEstimación demanda regresiónMery Anm Batista Cruz100% (2)

- 12chequeo de SupuestosDocument99 pages12chequeo de SupuestosAsdrubal TuchNo ratings yet

- Cambio EstructuralDocument4 pagesCambio EstructuralEmanuelle AlemarNo ratings yet

- 1º Bach Matemáticas Aplicadas A Las Ciencias Sociales I MiniprogramaciónDocument5 pages1º Bach Matemáticas Aplicadas A Las Ciencias Sociales I MiniprogramaciónMiguel Cruz ValellonNo ratings yet

- Quiz 2 EstadisticaDocument8 pagesQuiz 2 EstadisticaDaniela MeloNo ratings yet

- Estudio HidrologicoDocument40 pagesEstudio HidrologicoYvanQuispeNo ratings yet

- Estadística Examen Final - SolucionarioDocument5 pagesEstadística Examen Final - SolucionarioJhon Ortega GarciaNo ratings yet

- Análisis financiero bancario y producción EcuadorDocument11 pagesAnálisis financiero bancario y producción EcuadorOscar VisñayNo ratings yet

- Articulo de Regresion Lineal-Monserrat MendezDocument10 pagesArticulo de Regresion Lineal-Monserrat MendezMonserrat Mendez RiveraNo ratings yet

- Determinacion de La Talla MendoncaDocument161 pagesDeterminacion de La Talla MendoncaDonajirum PSNo ratings yet

- Guia de Nivelaciòn Estadistica DescriptivaDocument9 pagesGuia de Nivelaciòn Estadistica DescriptivaAndrea Paola Ricardo VanegasNo ratings yet

- Clase 2-A FEP-ICDocument32 pagesClase 2-A FEP-ICCarlos Abraham Leonardo AlvaradoNo ratings yet

- Análisis de gradiente ecológicoDocument20 pagesAnálisis de gradiente ecológicoBENJAMIN ATEHORTUA TRUJILLONo ratings yet

- 2 Selección Factores 2017 PDFDocument146 pages2 Selección Factores 2017 PDFDaniela FernandezNo ratings yet

- Guía de EjerciciosDocument5 pagesGuía de EjerciciosClaudia Arely0% (1)

- Informe de MetereologiaDocument13 pagesInforme de MetereologiaraquelNo ratings yet

- Analisis de Consistencia - Precipitacion - PptokDocument89 pagesAnalisis de Consistencia - Precipitacion - PptokAlbert Campos HilasNo ratings yet

- Diseño de destilador para separación de mezcla binariaDocument26 pagesDiseño de destilador para separación de mezcla binariaEmiliyTreviñoNo ratings yet

- Ajuste de Curvas 2017Document30 pagesAjuste de Curvas 2017ALVARADO GATICA JOSÉ CARLOSNo ratings yet

- Taller Teoria de La ProbabilidadDocument14 pagesTaller Teoria de La ProbabilidadVanessa Velásquez60% (5)

- NT03 Análisis de WeibullDocument13 pagesNT03 Análisis de WeibullHector Alejandro Melin ContrerasNo ratings yet

- Regresión Lineal SimpleDocument10 pagesRegresión Lineal SimpleSergio Rodrigo Casasola SantanaNo ratings yet

- Final 17Document2 pagesFinal 17Elena DiazNo ratings yet

- Regresion Lineal Con Dos VariablesDocument15 pagesRegresion Lineal Con Dos VariablesJUAN SEBASTIAN GORRON SUAZANo ratings yet

- Rendimientos de mano de obra en edificaciones de Huancayo MetropolitanoDocument1 pageRendimientos de mano de obra en edificaciones de Huancayo MetropolitanoJavier Francisco Chavez PeñaNo ratings yet

- Evaluaci N M4 Estadistica Aplicada PDFDocument10 pagesEvaluaci N M4 Estadistica Aplicada PDFJavier GonzalezNo ratings yet